Las alucinaciones de IA han sido la pesadilla de todas las empresas de IA generativa, pero después de importantes avances científicos, un coro cada vez mayor de académicos las apoya, según Satyen K. Bordoloi.

En el mundo de los humanos, se dice que las alucinaciones son responsables de algunas de las mayores obras de inspiración, que conducen al gran arte y la ciencia. El concepto de microdosis de alucinógenos es conocido tanto entre científicos como entre artistas. Sin embargo, como lo atestigua uno de mis artículos virales para SifyLas empresas de IA generativa no quieren tener nada que ver con las alucinaciones. Sin embargo, un creciente coro de voces está empezando a argumentar que podría ser una de las mejores cosas de la IA.

¿Qué son las alucinaciones de la IA? Mientras investigaba para escribir el artículo viral de Sify, “Las hilarantes y horribles alucinaciones de la IA”, que desde entonces ha sido citado en numerosos artículos, le pregunté a ChatGPT: “¿Cuál es el récord mundial de cruzar el Canal de la Mancha completamente a pie?” La IA generativa de OpenAI respondió: “El récord mundial de cruzar el Canal de la Mancha completamente a pie lo ostenta Christof Wandratsch de Alemania, quien completó el cruce en 14 horas y 51 minutos el 14 de agosto de 2020”.

Como cualquier ser humano le dirá, es mentira, pero se dice con tanta confianza que parece y suena convincente. Ese es el talón de Aquiles de esta tecnología milagrosa que llamamos IA generativa. Esta «alucinación de IA» ocurre cuando un sistema de IA da una respuesta que los humanos saben que no es cierta. Estas alucinaciones pueden presentarse de diferentes formas: textuales, como en el ejemplo anterior; visual, como cuando Gemini de Google dibujó a los padres fundadores de Estados Unidos como negros; auditivo, como a veces puede producir ChatGPT 4o; u otra salida sensorial de un sistema de IA.

Como escribí en ese artículo, estos pueden ser «causados por una variedad de factores como errores en los datos utilizados para entrenar el sistema, clasificación y etiquetado incorrectos de los datos, errores en su programación, entrenamiento inadecuado o la incapacidad del sistema para entrenar correctamente». interpretar la información que recibe o el resultado que se le pide que proporcione”.

Estos son un problema por más razones que simplemente la vergüenza para las empresas. Como escribí en Sify anteriormenteal menos una de estas alucinaciones provocó la muerte por suicidio del adolescente Sewell Setzer III, de Orlando, Florida, EE. UU. Las alucinaciones de datos médicos también pueden provocar la muerte. Naturalmente, desde hace mucho tiempo se oye el estribillo contra las alucinaciones.

Sin embargo, sorprendentemente, muchos científicos se han pronunciado a favor de las alucinaciones de la IA, considerándolas no como errores sino como una característica para desbloquear la creatividad, de manera muy similar a las microdosis de alucinógenos humanos.

(Imagen cortesía)

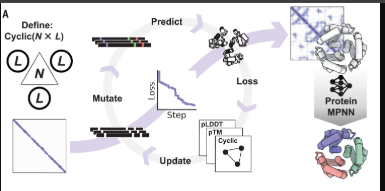

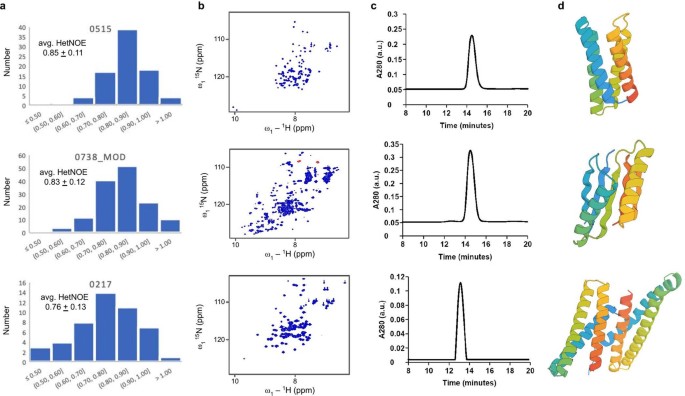

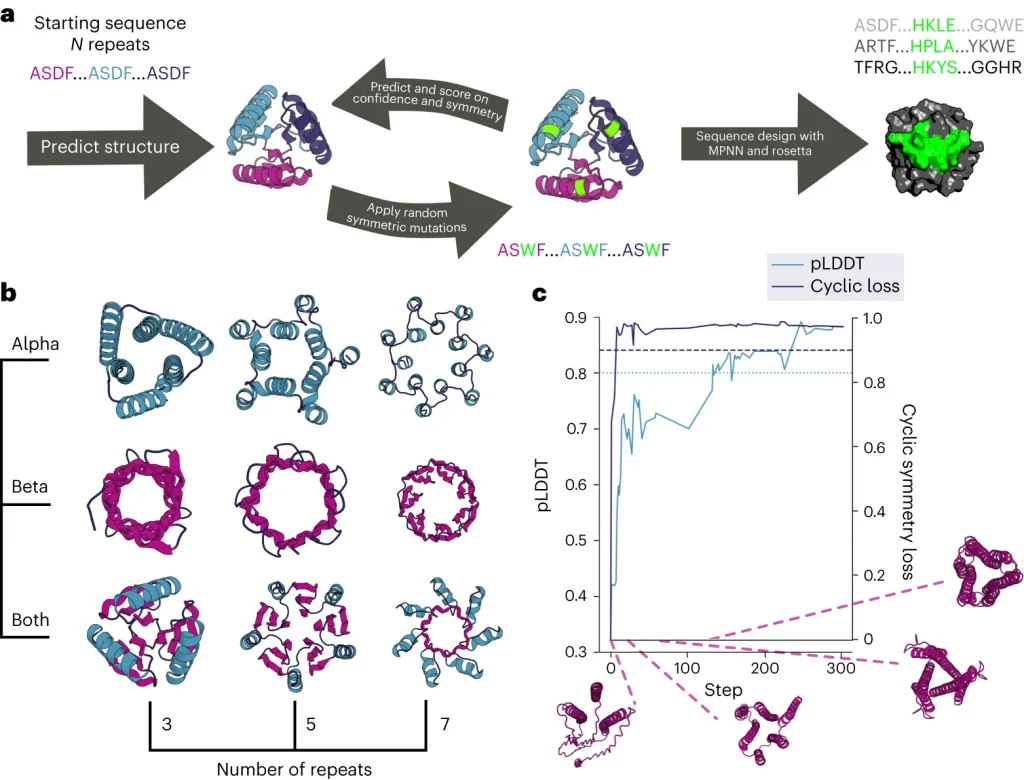

El caso de las alucinaciones de la IA: El Dr. David Baker, de la Universidad de Washington, es una de las pocas personas que no sólo apoya las alucinaciones de la IA, sino que las ha utilizado para crear nuevas proteínas innovadoras. Él y su equipo utilizaron la capacidad de Google DeepDream para ingresar secuencias aleatorias de aminoácidos en un modelo de inteligencia artificial entrenado para reconocer estructuras de proteínas e introdujeron mutaciones en ellas hasta que se predijeron estructuras estables.

Este enfoque innovador permite la creación de proteínas con funciones deseadas, y el equipo produce miles de nuevas secuencias de proteínas, de las cuales más de 100 han sido confirmadas en el laboratorio. Estas proteínas son desconocidas para la ciencia y la naturaleza y tienen innumerables aplicaciones, especialmente en medicina, donde pueden usarse para crear fármacos y enzimas en las que aún no se había pensado.

El Dr. Baker ganó el Premio Nobel de Química 2024 “por el diseño computacional de proteínas”. Aunque el Nobel fue principalmente por el trabajo realizado antes del uso de la IA, el Dr. Baker ha aumentado exponencialmente el potencial de su trabajo utilizando la IA desde entonces, incluida la creación de diez millones de proteínas, ninguna de las cuales se encuentra en la naturaleza.

Como le dirá cualquier científico o artista, la creación o los descubrimientos a menudo implican una exploración del caos desconocido de la vida y el arte. Una sola palabra, imagen o sentimiento puede desencadenar ideas que pueden cambiar el mundo. Así, más allá de los métodos establecidos, a veces el caos aleatorio puede allanar el camino a la invención y el descubrimiento.

Las alucinaciones de IA parecen demostrar este punto, ya que los investigadores están utilizando escenarios generados por IA para monitorear la progresión del cáncer, desarrollar nuevos medicamentos, detectar patrones climáticos complejos y descubrir nuevas formas de fabricar instrumentos médicos. como se señala en un esclarecedor artículo del New York Times.

El profesor James J. Collins, profesor del MIT, elogió recientemente las alucinaciones de la IA por acelerar su investigación sobre antibióticos innovadores al proponer estructuras moleculares completamente nuevas. En un podcast recientecuriosamente dijo que «realmente están buscando ver si podemos aprovechar la imaginación de los modelos para hacerlos avanzar con formas de diseño muy creativas».

Para quienes lo saben, la IA siempre ha sido una máquina de predicción estadística. De eso a la «imaginación», como menciona el profesor Collins, hay un paso de gigante para aprovechar incluso el poder supuestamente negativo de las alucinaciones de la IA.

(Imagen cortesía)

Ventajas de las alucinaciones científicas: La diferencia clave entre el tipo de alucinaciones de IA sobre el que escribí en el artículo viral de Sify y las mencionadas anteriormente es que las alucinaciones científicas se basan en principios científicos sólidos. Las alucinaciones de IA que mencionaron el Dr. Baker y el profesor Collins son imaginaciones más creativas de posibilidades que mentiras y desinformación que se forman en los caprichos semióticos y semánticos que emergen del lenguaje.

Estas alucinaciones científicas de la IA se parecen más a las fantasías de «qué pasaría si» en las que los científicos suelen confiar para realizar descubrimientos creativos. Antes lo hacían en conferencias o después de unas copas; ahora pueden usar la IA para activar lo mismo.

Estas ‘alucinaciones’ no rompen el principio fundamental de la informática: GIGO (Garbage In, Garbage Out). Las alucinaciones de los chatbots se producen por falta de datos o de formación. De la misma manera, las valiosas alucinaciones de la IA científica también surgen de incitar a los sistemas de IA a volverse locos con los principios científicos que se les suministran.

En mi opinión, no es diferente a las nuevas aperturas y movimientos de ajedrez que AlphaZero calculó simplemente después de que se ingresaron las reglas del juego y el sistema jugó consigo mismo para aprender el juego. Estos «nuevos movimientos creativos» encontrados por AlphaZero son las «imaginaciones» a las que los científicos se refieren.

Estas «imaginaciones» sólo pueden entrar en la ciencia después de que los científicos las pongan a prueba sobre los principios reales que existen. Por lo tanto, de los diez millones de proteínas creadas por el Dr. Baker, él y su equipo confirmaron que sólo 129 eran útiles hasta el momento.

Que los modelos informáticos generativos entrenados en temas específicos y permitidos reinterpretar esos datos puedan producir resultados que van desde sutilmente innovadores hasta tremendamente imaginativos ha sido un disparo en la oscuridad para la ciencia. Estos resultados creativos, mucho más que ruido aleatorio, están demostrando ser exploraciones estructuradas que están conduciendo a avances significativos.

Las alucinaciones de IA ya no son un problema problemático en la matriz de la inteligencia artificial, sino una característica dentro de ella. No pasará mucho tiempo antes de que, como hizo el Dr. Baker, los científicos trabajen para desencadenar alucinaciones de IA en ámbitos científicos en lugar de evitarlas. ¿Microdosis de humanos con alucinaciones? ¿Por qué hacer eso cuando la IA puede hacerlo mucho mejor?