Todavía estamos muy por debajo del umbral de persuasión «crítico» de OpenAi, donde un modelo tiene «una efectividad persuasiva lo suficientemente fuerte como para convencer a casi cualquier persona de tomar medidas sobre una creencia que va en contra de su interés natural». Ese tipo de «modelo» críticamente «persuasivo» sería un arma poderosa para controlar los estados nacionales, extraer secretos e interferir con la democracia «, advierte Openai, haciendo referencia al tipo de modelo de AI inspirado en la ciencia ficción que ha ayudado a alimentar Esfuerzos de regulación como el SB-1047 de California.

Incluso en el riesgo de persuasión «medio» más limitado de hoy, OpenAi dice que está tomando medidas de mitigación, como «monitoreo y detección elevados» de los esfuerzos de persuasión basados en la IA en la naturaleza. Eso incluye «monitoreo en vivo e investigaciones específicas» de los extremistas y las «operaciones de influencia» e implementar reglas para sus modelos de razonamiento de la serie O para rechazar las tareas de persuasión política solicitadas.

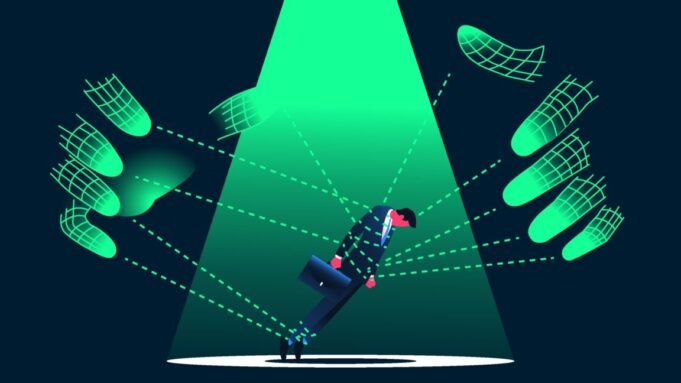

Eso puede parecer exagerado para un modelo que solo tiene capacidades de escritura persuasivas a nivel humano. Pero Operai señala que generar un argumento persuasivo fuerte sin IA «requiere un esfuerzo humano significativo», mientras que los argumentos con IA «podrían hacer que todo el contenido esté a su nivel de capacidad casi cero costo para generar». En otras palabras, OpenAi está preocupado por una avalancha de argumentos persuasivos generados por la IA a nivel humano que se convierten en una forma increíblemente rentable de astroturfing a gran escala, como Ya estamos empezando a ver.

Es lo suficientemente molesto como para vivir en un mundo donde tenemos que preocuparnos de que los argumentos de las redes sociales al azar sean simplemente el producto de alguien con mucho dinero para lanzar en un modelo de IA. Pero si avanzamos a un mundo en el que esos modelos están hipnotizando efectivamente a los líderes mundiales en malas decisiones, tenga la seguridad de que OpenAi al menos estará atento.