Una imagen de Jesús y medio camarón fusionados, una nave OVNI de SpaceX, niños pequeños horneando pasteles increíblemente perfectos y artículos bien escritos que describen problemas y soluciones mágicas al final.

No, no es necesario que los imagines; Estas imágenes, textos y medios ya están disponibles en Internet. Bienvenido al mundo de «Slop», que es similar al spam y puede describirse como basura fraudulenta, de baja calidad y dudosa generada por IA (inteligencia artificial). Abarca un término amplio y se refiere a contenido de IA de mala calidad y no deseado en libros, arte, redes sociales y, cada vez más, resultados de búsqueda en Internet. No es exactamente desinformación, sino texto vago, prosa inerte y narrativas extrañas. Y sí, está en todas partes, pero ¿es un problema tan grande?

¿Qué es la pendiente?

La palabra desperdicio hará que la mayoría de la gente imagine imágenes de comederos para el ganado paleados con montones de comida desagradable. Sin embargo, el primer contenido en línea que fue etiquetado como basura fue el contenido generado por IA en los foros de mensajes en línea. Básicamente, refleja términos similares para grandes cantidades de datos e información de baja calidad en Internet, como «baba rosa», que describe noticias de mala calidad que parecen noticias locales.

La basura puede adoptar cualquier forma: vídeos, imágenes, texto e incluso sitios web completos. Además, también podría llegar a la vida real. Por ejemplo, en noviembre de 2024, miles de personas se reunieron en El centro de Dublín para un desfile de Halloween inexistentepromocionado por un sitio web que utiliza imágenes falsas, reseñas falsas y algunas fotos reales de otros eventos sin relación con este. Incluso hubo una «basurera de la vida real» en la forma del ahora infame Experiencia Willy Wonka en Glasgow. Promocionado como una experiencia familiar interactiva utilizando imágenes de ensueño de IA, el evento fue de baja calidad en realidad, comenzó pero se canceló a mitad de camino.

Eso no es todo. ¿Google sugirió agregar pegamento no tóxico para hacer que el queso se adhiera a la pizza? ¿Hay una publicación de Facebook o un libro digital de bajo precio que no es el que estabas buscando y que aparece de la nada en tu feed o en tus resultados de búsqueda? Toda la basura.

¿Por qué la pendiente es un problema?

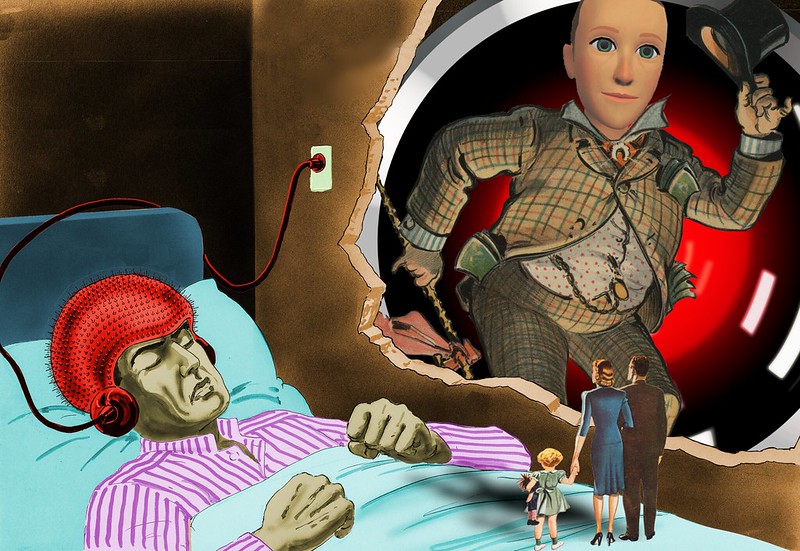

Al final, la basura generada por IA alimenta a los sitios web que quieren optimizar el SEO lo más barato posible. Esto podría afectar la forma en que reciben el tráfico los medios de comunicación y cómo interactuamos con la información en la web. Por otro lado, se ha comparado el slop con el spam de correo electrónico, cuyas plataformas se volvieron bastante eficientes a la hora de filtrar. Incluso Alucinaciones de IAque prevalecían en las primeras versiones de los chatbots de IA, han disminuido en sus versiones posteriores, pero la tendencia se ha mantenido. La pregunta es: ¿se esfumará el vertido o podría degradar todo el ecosistema de la información?

Una preocupación válida es que, dado que el texto generado por IA es más barato, más rápido y más fácil de producir, proliferará en la web. Eventualmente, si se ingresa como datos de entrenamiento en ML y LLM (aprendizaje automático y grandes modelos de lenguaje), podría llevar a que el valor y la calidad de la información se erosionen enormemente.

Luego está el problema del «discurso descuidado», un conjunto de riesgos definidos en un papel por los académicos Sandra Wachter, Chris Russell y Brent Mittelstadt. Según ellos, el discurso descuidado es un resultado generado por IA que presenta información demasiado simplificada, imprecisiones sutiles o respuestas sesgadas que se hacen pasar, en un tono confiado, como la verdad. No es desinformación y el objetivo no es engañar, sino más bien parecer confiado y convincente. Después de todo, lo más peligroso para la sociedad no es un mentiroso; es una mentira. ¿El problema? El discurso descuidado fácilmente podría pasar desapercibido.

Por último, está el problema de los desperdicios de IA disfrazados de «noticias» procedentes de sitios web generados por IA. Estos sitios web podrían dar como resultado sitios optimizados para SEO para maximizar los ingresos publicitarios; piense en Buzzfeed o The Onion con esteroides con términos de búsqueda repetidos y titulares de clickbait. Si bien la mayoría son sitios web de clickbait de baja calidad que publican contenido sobre entretenimiento y celebridades, otros también cubren temas como política, obituarios y criptomonedas.

En febrero de 2024, por ejemplo, un artículo de Wired informó sobre el empresario serbio Nebojša Vujinović Vujo, que compró sitios de noticias abandonados, los llenó de contenido basura generado por IA y se embolsó enormes cantidades de dinero en ingresos publicitarios.

Los ‘deepfakes’ de IA de las víctimas del huracán Helene circulan en las redes sociales y ‘dañan a personas reales’ https://t.co/UIpRD7vxhv pic.twitter.com/jDJ0Ll0Sci

– Correo de Nueva York (@nypost) 5 de octubre de 2024

¿Está el Slop aquí para quedarse y matar?

Slop pasó a ser el centro de atención, si podemos llamarlo así, cuando Google incorporó a sus resultados de búsqueda en EE. UU. su modelo de IA Gemini a finales de 2023. En lugar de dirigir a los usuarios hacia enlaces útiles, Gemini intentó resolver consultas directamente con una “Descripción general de IA”. : un fragmento de texto encima de la página de resultados que mejor adivinaba lo que buscaban los usuarios. Esto también llevó a Microsoft a incorporar su IA en los resultados de búsqueda de Bing. No es sorprendente que Google haya decidido revertir algunas funciones hasta que se puedan solucionar los problemas.

Puede que el slop no parezca dañino a primera vista, pero el problema es que está en Internet y más allá. Se ha acusado a las plataformas digitales de inclinarse mucho hacia la pendiente y se han hecho anuncios para agregar funciones para que los usuarios creen contenido generado específicamente por IA. Sí, la IA puede ayudar con la eficiencia, la flexibilidad y la escalabilidad, pero no debería comprometer el contenido, los valores de la redacción ni el criterio editorial. Si terminarán creando publicaciones atractivas y únicas o llenando feeds con basura digital, solo el tiempo lo dirá.